Beş popüler yapay zeka botu test edildi! %58 sorunlu yanıt oranı dikkat çekti

BMJ Open'da yayımlanan kapsamlı araştırma, yapay zeka sohbet botlarının sağlık alanında verdiği tavsiyelerde ciddi sorunlara işaret etti. Özellikle referansların doğruluğu ve verilen bilgilerin güvenilirliği konusunda uzmanlar uyarıda bulundu. Araştırmada yer alan beş popüler sohbet botu, sağlık sorularına verdikleri yanıtlarda yüksek oranda sorunlu sonuçlar ortaya koydu.

BMJ Open'da yayımlanan yeni bir araştırma, yapay zeka sohbet botlarının sağlık alanında verdiği tavsiyelerin güvenilirliğini masaya yatırdı. Araştırmacılar, dünyanın en çok kullanılan beş sohbet botunu sistematik bir stres testine tabi tuttu. ChatGPT, Gemini, Grok, Meta AI ve DeepSeek üzerinde gerçekleştirilen bu çalışma, kullanıcıların sağlıkla ilgili sorularına verilen yanıtların doğruluğunu ve referansların geçerliliğini değerlendirdi. Sonuçlar, sohbet botlarının tıbbi konularda önemli oranda yanlış ve yanıltıcı bilgiler sunduğunu ortaya koydu. Özellikle tıbbi referansların doğruluğu konusunda ciddi eksiklikler tespit edildi. Test edilen beş sohbet botu, 50 farklı sağlık sorusuna verdiği yanıtlarda hem içerik hem referans bazında güven sarsıcı sonuçlar verdi. Araştırmada, verilen yanıtların neredeyse %20'sinin son derece sorunlu, yarısının ise sorunlu olduğu belirlendi. Hatta hiçbir sohbet botu, 25 denemeden birinde bile tamamen doğru referans listesi sunamadı. Bu bulgular, sağlık alanında yapay zeka sohbet botlarının kullanımında dikkatli olunması gerektiğini bir kez daha gündeme taşıdı.

Uzmanlar: 'Yapay zeka tıbbi referanslarda güven vermiyor'

Çalışmada görev alan iki uzman, sohbet botlarının verdiği yanıtları bağımsız olarak değerlendirdi ve sonuçlar endişe verici boyuta ulaştı. Beş sohbet botunun yanıtlarının yaklaşık %50'si sorunlu, %20'si ise son derece sorunlu olarak sınıflandırıldı. Özellikle Grok, %58'lik sorunlu yanıt oranı ile en düşük performansı gösterdi. ChatGPT ve Meta AI ise sırasıyla %52 ve %50 oranında sorunlu yanıt verdi. Araştırmacılar, sohbet botlarının tıbbi referans üretme konusunda güvenilirlikten uzak olduğunu vurguladı. 250 sorudan yalnızca iki tanesi yanıtlanmayı reddedildi, kalan tüm yanıtlarda ise referansların ya eksik ya da hatalı olduğu görüldü. Hatalar arasında yanlış yazar isimleri, bozuk bağlantılar ve tamamen uydurulmuş makaleler yer aldı. Bu durum, özellikle sağlık alanında yapay zeka sohbet botlarının sunduğu referansların kanıt gibi algılanmasının ciddi bir risk oluşturduğunu gösteriyor. Kullanıcılar, düzgün formatlanmış bir kaynak listesiyle karşılaştıklarında, içeriğin doğruluğunu sorgulamadan kabul edebiliyor. Bu nedenle, yapay zeka sohbet botlarının tıbbi referansları, mutlaka bağımsız kaynaklarla doğrulanmalı.

Sağlık sorularında yapay zeka botları neden yanıltıyor?

Sohbet botlarının sağlık alanında neden sıkça yanlış bilgi verdiği sorusu da araştırmanın odak noktalarından biri oldu. Uzmanlar, yapay zeka sohbet botlarının temelinde dil modellerinin yer aldığını ve bu modellerin bilgiye sahip olmadığını belirtti. Botlar, eğitim aldıkları veri setlerine ve bağlama göre istatistiksel olarak en olası kelimeyi seçerek yanıt üretiyor. Eğitim verileri ise yalnızca hakemli makalelerle sınırlı değil; Reddit başlıkları, sağlık blogları ve sosyal medya tartışmaları gibi farklı kaynaklardan oluşuyor. Bu durum, sohbet botlarının tıbbi bilgi üretirken güvenilirlikten uzaklaşmasına yol açıyor. Araştırmada, sohbet botlarının yanıtlarının özellikle açık uçlu sorularda daha sorunlu olduğu tespit edildi. Açık uçlu soruların %32'si son derece sorunlu yanıtlar içerirken, kapalı sorularda bu oran %7'ye geriledi. Gerçek dünyada ise kullanıcıların büyük bölümü açık uçlu sorular soruyor ve bu, yanlış bilgi riskini artırıyor. Ayrıca, araştırmacılar sohbet botlarını yanıltıcı cevaplar vermeye zorlayan istemler de kullandı. Bu, yapay zeka güvenlik araştırmalarında sıkça uygulanan 'kırmızı takım' testlerinin bir parçası olarak değerlendirildi. Ancak, ücretsiz sürümlerin test edildiği bu çalışmada, çoğu insanın gerçek hayatta da bu ücretsiz sürümleri kullandığı vurgulandı.

Referansların doğruluğunda büyük eksiklik: Kullanıcılar dikkatli olmalı

Araştırmanın çarpıcı bulgularından biri de, sohbet botlarının bilimsel referans üretme konusunda yaşadığı ciddi eksiklikler oldu. Araştırmacılar, her bot yanıtında on bilimsel referans talep etti ancak ortalama tamlık puanı yalnızca %40 seviyesinde kaldı. Hiçbir sohbet botu, 25 denemede tek bir tamamen doğru referans listesi oluşturamadı. Yanlış yazar isimleri, hatalı bağlantılar ve uydurma makaleler, referans listesinin güvenilirliğini zedeledi. Bu durum, sağlık alanında yapay zeka sohbet botlarının sunduğu bilgilerin sorgulanmadan kullanılmasının tehlikeli sonuçlar doğurabileceğini gözler önüne serdi. Düzenli bir kullanıcı, referans listesinin düzgün formatlanmış olmasına güvenerek, içeriğin doğruluğunu sorgulamadan kabul edebiliyor. Oysa, referansların büyük bir kısmı ya yanlış ya da tamamen uydurma bilgiler içeriyor. Bu nedenle, yapay zeka sohbet botlarının sunduğu tıbbi referanslar, mutlaka bağımsız kaynaklarla karşılaştırılmalı ve doğruluğu titizlikle kontrol edilmeli.

Diğer araştırmalar da benzer risklere işaret ediyor

BMJ Open'da yayımlanan bu çalışma, yapay zeka sohbet botlarının sağlık alanındaki zaaflarının yalnızca tek bir araştırmaya özgü olmadığını gösteriyor. Şubat 2026'da Nature Medicine'da yayımlanan bir başka araştırma, sohbet botlarının doğru tıbbi cevabı %95 oranında verebildiğini ortaya koydu. Ancak, bu botları kullanan gerçek kişilerin doğru cevabı anlama ve uygulama oranı %35'in altında kaldı. Bu bulgu, yapay zeka sohbet botlarının sunduğu bilginin doğruluğu kadar, kullanıcıların bu bilgiyi anlayıp kullanabilmesinin de hayati önemde olduğunu gösteriyor. Jama Network Open'da yayımlanan bir başka çalışma ise, 21 yapay zeka modelinin test edildiği bir ortamda, yalnızca temel bilgilerle tıbbi tanı koymada %80'in altında başarı sağlandığını gösterdi. Ek bilgiler eklendiğinde doğruluk oranı %90'a yükseldi. Nature Communications Medicine'da yer alan bir başka araştırmada ise, sohbet botlarının uydurulmuş tıbbi terimleri kolayca tekrar ettiği ve bu terimler hakkında ayrıntılı bilgi verdiği tespit edildi. Tüm bu çalışmalar, yapay zeka sohbet botlarının sağlık alanında bağımsız otorite olarak kullanılmasının riskli olduğunu ve mutlaka insan denetimine ihtiyaç duyulduğunu vurguluyor.

Yapay zeka sohbet botları sağlık alanında nasıl kullanılmalı?

Uzmanlar, yapay zeka sohbet botlarının sağlık alanında tamamen ortadan kaldırılması gerektiğini savunmuyor. Bu teknolojiler, karmaşık konuları özetleme, doktor için soru hazırlama ve araştırma süreçlerine başlangıç noktası oluşturma gibi alanlarda önemli kolaylıklar sunuyor. Ancak, sohbet botlarının önerdiği tıbbi bilgilerin ve referansların mutlaka bağımsız kaynaklarla karşılaştırılması gerekiyor. Özellikle sağlık iddiaları söz konusu olduğunda, kullanıcıların verilen bilgiyi sorgulaması ve doğrulaması büyük önem taşıyor. Araştırmacılar, sohbet botlarının yanıtlarının kendinden emin bir dil taşımasına rağmen, çoğu zaman uyarı ve şüphe içermediğini belirtti. Bu nedenle, kullanıcıların sohbet botlarından aldıkları yanıtları doğrudan uygulamadan önce, mutlaka bir sağlık profesyoneline danışmaları tavsiye ediliyor. Yapay zeka sohbet botlarının sunduğu tıbbi referanslar, asla kesin kanıt olarak kabul edilmemeli; aksine, kontrol edilmesi gereken öneriler olarak değerlendirilmelidir.

Sonuç olarak, BMJ Open'da yayımlanan bu kapsamlı araştırma, yapay zeka sohbet botlarının sağlık alanında sunduğu tavsiyelerin ve referansların güvenilirliği konusunda ciddi soru işaretleri doğurdu. Kullanıcılar, sağlıkla ilgili kararlarını yalnızca bu tür teknolojilere dayandırmamalı; verilen bilgilerin doğruluğunu mutlaka uzman görüşüyle teyit etmeli. Yapay zeka sohbet botları, sağlık alanında bir araç olarak değerlendirilmeli, ancak bağımsız bir otorite olarak görülmemeli. Araştırmanın bulguları, sağlık alanında yapay zeka teknolojilerinin kullanımında dikkatli ve bilinçli olunması gerektiğini net biçimde ortaya koydu.

- Popüler Haberler -

Anthropic'ten yapay zeka bombası! Claude Mythos'un tehlikesi dünyayı sarstı

3D yazıcıyla su altında beton basımında yeni dönem! Dayanıklılık testleri başlıyor

Apple'dan iOS 27 için radikal karar! Dört model dışarıda kaldı

SAHA 2026 kapılarını rekorlarla açacak! Yeni ürünler vitrine çıkacak

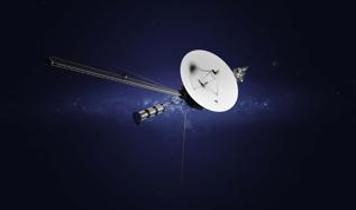

Ulaştırma Bakanı Uraloğlu: Türksat 6A ile Türkiye dünyanın önde gelen haberleşme uyduları arasında!

Araştırmacılardan uyarı! ChatGPT beyin aktivitesini azaltıyor